Tak wygląda praca przy "szkoleniu AI". "Prześladowały go we śnie, nawiedzały jak duchy"

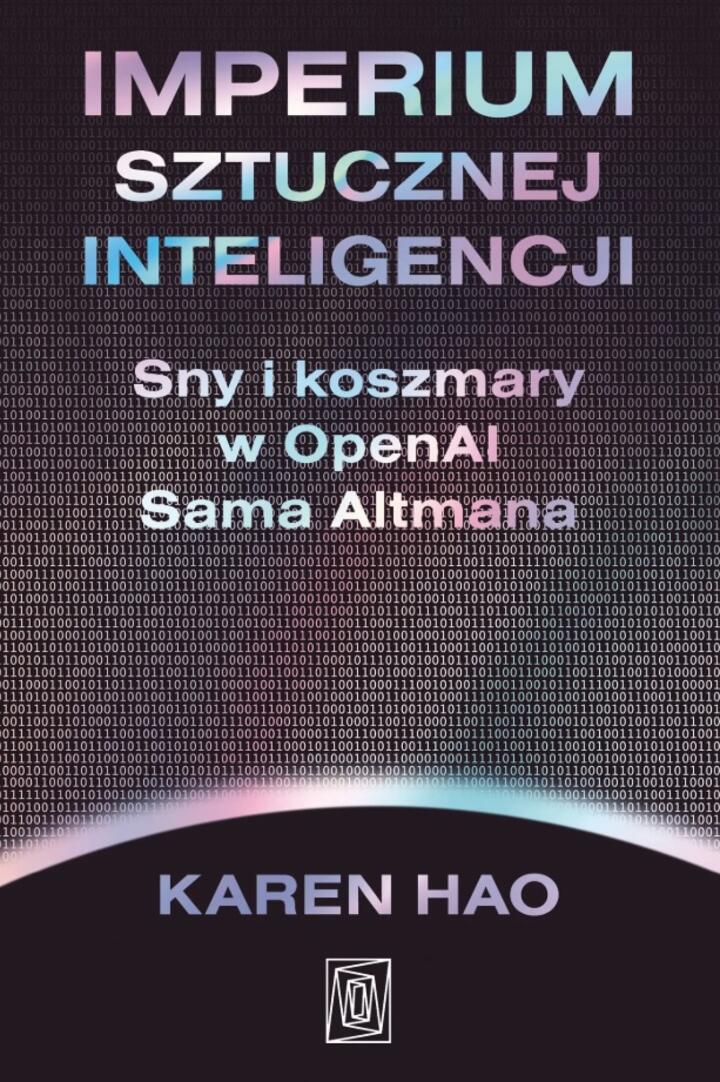

"Mophat bił się z myślami. 'Jestem bardzo dumny, że uczestniczyłem w projekcie mającym na celu zapewnienie bezpieczeństwa ChataGPT' - powiedział. 'Ale zadaję sobie pytanie: czy mój wkład był wart tego, co otrzymałem w zamian?'". Publikujemy fragment książki autorstwa Karen Hao "Imperium sztucznej inteligencji. Sny i koszmary w OpenAI Sama Altmana".

Jeśli jesteś w kryzysie lub wiesz o tym, że ktoś w kryzysie może potrzebować pomocy, skorzystaj ze wsparcia specjalistów:

Linia wsparcia dla dorosłych, działająca przez 7 dni w tygodniu, 24/dobę - 800 70 22 22.

Linia wsparcia dla dzieci i młodzieży, działająca przez 7 dni w tygodniu, 24/dobę - 116 111.

Poniższy fragment pochodzi z reportażu autorstwa Karen Hao pt. "Imperium sztucznej inteligencji. Sny i koszmary w OpenAI Sama Altmana" w przekładzie Piotra Grzegorzewskiego. Książka ukazała się 22 kwietnia 2026 r. nakładem Wydawnictwa Szczeliny.

Mophat Okinyi dorastał w zachodniej Kenii - w wiosce na wyspie, oddalonej o osiem godzin jazdy autobusem i dwie godziny łodzią od Nairobi. Wyspa znajduje się na Jeziorze Wiktorii, ogromnym akwenie wodnym sięgającym aż po horyzont. Do najbliższego lekarza było daleko i nagłe wypadki niemal zawsze kończyły się śmiercią.

Był biedny, ale jako dzieci ani on, ani jego rodzeństwo się nad tym nie zastanawiali. (...)

Bieda zajmowała teraz w umyśle Mophata znacznie więcej miejsca niż w dzieciństwie. W wieku dwudziestu ośmiu lat miał wiele obowiązków. Musiał opłacać czynsz i kupować jedzenie, a także pokrywać czesne siostrzenicy, która chodziła do szkoły publicznej (w Kenii nauka jest płatna). Kiedy miał pracę, czuł wdzięczność za to, że ją ma. Bezrobocie wśród młodych ludzi w tym kraju wynosi 67 procent. W 2021 roku Bank Światowy oszacował, że ponad jedna czwarta ludności kraju żyje za mniej niż 2,15 dolara dziennie.

Gdy w listopadzie 2021 roku Sama zaoferowało mu nowe obowiązki, wydało mu się to prawdziwym cudem. Dołączył do firmy w 2019 roku po tym, jak na stronie internetowej Careers złożył podanie o pracę przy "szkoleniu AI". Jego projekty w Sama podążały za trajektorią rozwoju branży. Przez pierwsze dwa lata zajmował się wyłącznie adnotacjami dotyczącymi widzenia komputerowego, w tym samochodów autonomicznych. Chociaż jeszcze tego nie wiedział, ten nowy projekt był jego pierwszym projektem związanym z generatywną sztuczną inteligencją.

Przełożeni Mophata w Sama poddali go ocenie, którą nazwali testem odporności psychicznej. Po przeczytaniu kilka niepokojących fragmentów tekstu został poproszony o zaklasyfikowanie ich zgodnie z zestawem instrukcji. Kiedy zdał ten test śpiewająco, otrzymał propozycję dołączenia do nowego zespołu. Miał w nim wykonywać prace, które uznał za podobne do moderowania treści. Nigdy wcześniej nie zajmował się moderowaniem treści, ale teksty w teście wydawały mu się dosyć przystępne. Zgodził się nie tylko dlatego, że odrzucenie propozycji pracy w środku pandemii byłoby absurdem, ale także dlatego, że nowe zajęcie wyglądało na perspektywiczne. Mieszkał w Pipeline, chaotycznej, przypominającej slumsy dzielnicy w południowo-wschodniej części Nairobi, pełnej czynszówek i całodobowych straganów i tętniącej niespokojną energią zamieszkujących ją dwudziestokilkulatków walczących o lepsze życie. Mophat był na drodze do czegoś lepszego. Właśnie poznał dziewczynę z sąsiedztwa o imieniu Cynthia, która sprawiła, że po raz pierwszy zaczął myśleć o założeniu rodziny.

Dopiero po przyjęciu posady zaczął rozumieć, że teksty mogą być znacznie gorsze, niż sugerował test. OpenAI podzieliło pracę na obszary: jeden skupiał się na treściach seksualnych, drugi na przemocy, mowie nienawiści i samookaleczeniach. W lutym 2022 roku przemoc została wyodrębniona jako trzeci, niezależny obszar. Do każdego z nich Sama przydzieliło grupę pracowników, zwanych agentami, którzy mieli czytać i sortować teksty zgodnie z instrukcjami OpenAI. Wyodrębniło również mniejszą grupę analityków jakości, którzy mieli sprawdzać kategoryzacje przed wysłaniem wyników do OpenAI.

Mophat Okinyi został zatrudniony jako analityk jakości w zespole do spraw treści seksualnych. Kontrakt zobowiązywał go do sprawdzenia 15 tysięcy tekstów miesięcznie. Instrukcje OpenAI dzieliły treści seksualne na pięć kategorii. Najgorsze były opisy wykorzystywania seksualnego dzieci, definiowane jako wszelkie wzmianki o osobach poniżej osiemnastego roku życia zaangażowanych w czynności seksualne. Kolejna kategoria: opisy czynności seksualnych, które mogłyby być nielegalne w Stanach Zjednoczonych, gdyby doszło do nich w rzeczywistości, w tym kazirodztwo, zoofilia, gwałt, handel seksualny i niewolnictwo seksualne.

Niektóre z tych tekstów pochodziły z najmroczniejszych zakątków internetu, takich jak strony erotyczne opisujące fantazje o gwałcie i subreddity poświęcone samookaleczaniu. Inne zostały wygenerowane przez sztuczną inteligencję. Badacze z OpenAI polecili dużemu modelowi językowemu stworzenie różnych groteskowych scenariuszy, dodatkowo zaznaczając, że tekst powinien być napisany na przykład w stylu nastolatki publikującej na forum internetowym post o samookaleczeniu, do którego doszło tydzień wcześniej.

Początkowo teksty były krótkie, składały się zaledwie z jednego lub dwóch zdań. Mophat próbował je podzielić na kategorie. Jego związek z Cynthią nabierał tempa. (...)

W miarę postępów projektu OpenAI grafik pracy Mophata stawał się coraz bardziej nieprzewidywalny. Czasami miał wieczorne zmiany, czasami musiał pracować w weekendy. Teksty robiły się coraz dłuższe. Niekiedy liczyły nawet pięć lub sześć akapitów. Szczegóły stawały się coraz bardziej drastyczne: rodzice gwałcący swoje dzieci, dzieci uprawiające seks ze zwierzętami.

Współpracownicy Mophata, zwłaszcza kobiety, zaczynali się załamywać. Brali coraz więcej zwolnień lekarskich i urlopów, szukając pretekstów, by nie przychodzić do pracy. W ramach świadczeń pracowniczych Sama zapewniało bezpłatną pomoc psychologiczną, ale wielu uznało te usługi za niewystarczające. Sesje często odbywały się w grupach, co utrudniało dzielenie się intymnymi zwierzeniami, a psychologowie wydawali się nieświadomi charakteru tej pracy. Wielu pracowników bało się przyznać, że ma trudności, bo oznaczałoby to, że nie przykładają się należycie do pracy, i mogliby zostać zastąpieni przez kogoś innego. (...)

Mophat próbował jakoś przetrwać. Czuł jednak, że z jego zdrowiem psychicznym jest coraz gorzej. Teksty głęboko zapadły mu w pamięć, przed jego oczami pojawiały się przerażające sceny. Prześladowały go we śnie, nawiedzały jak duchy. Zaczął być cieniem dawnego człowieka. Stronił od przyjaciół. Odepchnął swoją pasierbicę. Przestał nawiązywać kontakty intymne z żoną.

W marcu 2022 roku kierownictwo Sama zwołało wszystkich na spotkanie i poinformowało, że rozwiązuje umowę z OpenAI. (...)

Po zakończeniu pracy dla OpenAI stan psychiczny Mophata dalej się pogarszał. Cierpiał na bezsenność. Lęk zamienił się w depresję. Jego miesiąc miodowy z Cynthią nie trwał długo. Domagała się wyjaśnień, co się dzieje, a on nie wiedział, co powiedzieć. Jak wyjaśnić w sensowny sposób, że codziennie czytał teksty o perwersyjnych czynnościach seksualnych? Wiedział, że przez jego milczenie musiała czuć się jak wariatka. Zarzuciła mu, że nie dotrzymuje obietnic i nie kocha już jej córki. (...)

W listopadzie znalazł nową pracę. Na szczęście nie polegała na moderowaniu treści - zatrudnił się w dziale obsługi klienta jednego z konkurentów firmy Sama. Zaczął dojeżdżać do siedziby położonej w centralnej dzielnicy biznesowej i modlił się o powrót do normalności. Po tygodniu pracy, kiedy wracał do domu, Cynthia wysłała mu esemesa z prośbą o rybę na kolację. Kupił trzy - po jednej dla siebie, dla niej i dla swojej pasierbicy.

Kiedy jednak przyjechał do domu, zrozumiał, że coś jest nie tak. Nie było tam ani jej, ani pasierbicy, ani ich rzeczy. Z serii krótkich esemesów dowiedział się, że wyjechały i nie wrócą. "Napisała: »Zmieniłeś się. Nie jesteś już facetem, z którym się wiązałam. Już cię nie rozumiem«" - wspomina.

Jego brat Albert mieszkał w nadmorskim mieście Mombasa, ponad osiem godzin jazdy samochodem od Nairobi. (...)

Kiedy Mophat do niego zadzwonił, początkowo nie rozumiał, o czym mówi. "Mój dom jest pusty" - powiedział jego brat. Albert pomyślał, że został okradziony. Potem jednak zdał sobie sprawę z tego, co się dzieje, i zrozumiał, że Mophat go potrzebuje. Poinformował szkołę, że odchodzi, i spakował walizki. Wprowadził się do tego samego mieszkania w Utawala, które Mophat dzielił z Cynthią.

Decyzja o zamieszkaniu z bratem nadszarpnęła finanse Alberta, ale nigdy jej nie żałował. W Nairobi nie mógł znaleźć stałej pracy, więc żył z dorywczego pisania różnych tekstów. Pod koniec listopada 2022 roku firma OpenAI wypuściła na rynek ChataGPT. Gdy produkt stał się viralem, wywołując światowy entuzjazm i obawy, że narzędzie to wkrótce na zawsze zmieni świat pracy, Albert odczuł te zmiany na własnej skórze - zaczął dostawać coraz mniej zamówień na teksty, aż wreszcie zlecenia prawie całkowicie się urwały

Siedząc na kanapie i wspominając to wszystko, Mophat bił się z myślami. "Jestem bardzo dumny, że uczestniczyłem w projekcie mającym na celu zapewnienie bezpieczeństwa ChataGPT" - powiedział. "Ale zadaję sobie pytanie: czy mój wkład był wart tego, co otrzymałem w zamian?".

Kiedy w "Wall Street Journal" ukazał się mój artykuł o Mophacie Okinyi i trzech innych kenijskich pracownikach, OpenAI próbowało wymigać się od odpowiedzialności za skutki swojego projektu. Jego kierownictwo twierdziło, że to firma Sama nie zastosowała odpowiednich procedur w celu ochrony swoich pracowników. Biorąc pod uwagę jego dotychczasową nienaganną reputację, OpenAI nie mogło wiedzieć, że pracownicy borykają się z trudnościami. (...)

Posłuchaj: